自控与人控在工业安全中的博弈 以人工智能基础软件开发为视角

工厂安全事故频发,引发了社会对安全生产管控模式的深度思考。在传统工业向智能制造转型的浪潮中,‘自控’(自动化控制,尤其是基于人工智能的智能控制)与‘人控’(传统人工管理与操作)的可靠性之争,成为了一个核心议题。从人工智能基础软件开发的视角审视这一问题,我们能获得更为深刻和前沿的见解。

需要明确‘自控’与‘人控’的本质与局限。传统‘人控’依赖于操作人员的经验、警觉性和纪律性。其优势在于人类的灵活判断、应急处置能力和对复杂非标情况的适应性。人控的可靠性受制于生理极限(如疲劳、注意力分散)、心理因素(如侥幸心理、情绪波动)以及管理漏洞。大量事故分析表明,人为失误是导致安全事件的主要原因之一。

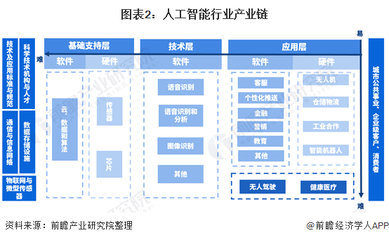

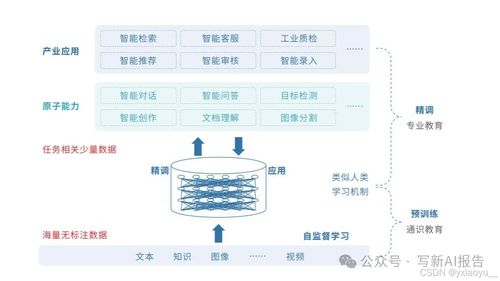

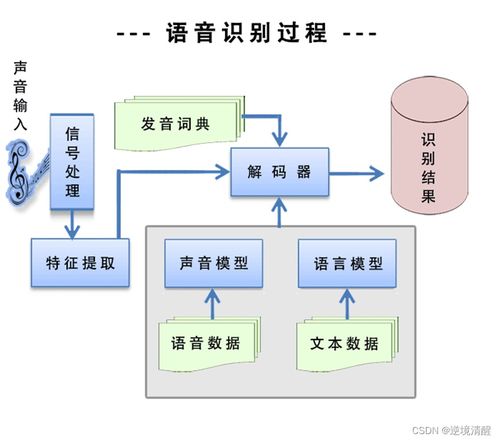

而现代‘自控’系统,特别是融合了人工智能技术的系统,正逐步改变这一局面。人工智能基础软件,如机器学习框架、计算机视觉库、预测性维护算法平台等,为构建智能安全管控系统提供了核心工具。基于此开发的系统能够实现7x24小时不间断的监测,通过传感器网络实时采集设备状态、环境参数(温度、压力、有毒气体浓度等)和人员行为数据。利用机器学习模型,系统可以识别人类难以察觉的细微异常模式,实现故障的早期预测与预警,防患于未然。例如,通过分析设备振动频谱的微小变化,AI能提前数小时甚至数天预警机械故障,避免因突发停机或破裂导致的安全事故。

在直接风险干预方面,智能自控系统也展现出高可靠性。当检测到参数超越安全阈值或识别出如人员闯入危险区域、未按规定佩戴防护装备等风险行为时,系统可以毫秒级响应,自动执行紧急停机、关闭阀门、启动通风或喷淋等操作,其反应速度和一致性远超人类。这种能力在化工、能源等高危行业尤为重要。

这并不意味着‘自控’可以完全替代‘人控’。当前人工智能技术的发展阶段决定了其局限性。AI模型的可靠性严重依赖于训练数据的质量、数量和代表性。面对训练数据中未曾出现的‘长尾’极端情况或新型风险,系统可能失效或做出错误决策。AI系统的决策过程常被视为‘黑箱’,其内在逻辑缺乏透明性,这在安全至上的工业领域可能带来信任和可追溯性问题。系统本身可能面临硬件故障、网络攻击(如数据投毒、对抗性攻击)等新的风险。

因此,最可靠的路径并非二者择一,而是追求‘人机协同’的智能增强管控模式。人工智能基础软件开发应致力于此方向:

- 构建可信、可解释的AI安全模型:开发不仅精度高,而且能提供决策依据(如突出关键风险特征)的算法,让管理人员能够理解和信任AI的预警,实现人机互信。

- 设计以人为中心的智能交互系统:将AI作为“超级助手”,通过增强现实(AR)、自然语言交互等方式,将关键信息、风险分析和处置建议直观地推送给现场人员,增强其态势感知和决策能力,而非简单地取代人。

- 实现动态风险评估与自适应控制:利用软件平台整合多源数据,实现工厂安全状态的动态、全景式评估,并能使控制系统参数根据实时风险水平自适应调整,在安全与效率间取得最优平衡。

- 强化系统的韧性与安全性:在基础软件层融入冗余设计、故障安全机制以及针对网络攻击的防御能力,保障自控系统自身的安全可靠。

结论是,在人工智能基础软件的有力支撑下,智能自控系统在监测预警的广度、深度和响应速度上具有无可比拟的优势,能极大弥补人控的固有缺陷,显著提升工业安全的整体可靠性。但最终的安全屏障仍需‘人’的参与——负责战略制定、伦理监督、复杂异常处置以及对自控系统的维护与管理。未来的工厂安全,必将是一个‘人机融合、智能增强’的生态系统,其中可靠的人工智能基础软件是连接、赋能与优化这一系统的关键基石。

最新产品